2024AI应用报告:海外发展迅速,国内追赶正当时

1.模型层:大语言模型加深场景结合,多模态持续迭代

谷歌BERT开启大模型时代,ChatGPT推升发展热潮。1956年,达特茅斯研讨会正式提出人工智能,标志着人工智能学科诞生。此后60余年,专家系统、深度学习等关键技术不断成熟,为大模型发展奠定基础。回顾大模型发展历程,可分为以下三个阶段:1)大模型开端:2018年,谷歌发布3亿参数规模的自然语言处理模型BERT,标志着人工智能正式进入大模型时代。2)大模型探索:2020年,GPT-3发布,模型参数规模大幅提升至1750亿。随后,谷歌、微软和英伟达相继推出自然语言理解或生成模型,对大模型技术的探索持续推进。3)大模型热潮:2022年底,基于迭代后的GPT-3.5模型构建的ChatGPT发布,引起市场广泛关注,AI迎来新一轮发展热潮。此后,OpenAI的GPT-4、谷歌的Gemini 1.5 Pro、Anthropic的Claude3相继推出,不断提高大模型能力边界。

模型层持续迭代,带动下游应用层发展。类比于软件行业,基于服务器、操作系统等硬件和系统,开发针对不同下游场景的软件,AI产业可分为以下三个层级:1)基础设施层:由计算硬件GPU和TPU、为AI计算提供专用算力的智算平台、以及各类AI工具,如模型微调、数据标注等组成,三者共同构成了AI上层建筑的底层设施;2)模型层:依托于大量训练数据、算力资源构建的AI模型层由闭源模型和开源模型组成。两者相辅相成,共同推动AI应用发展;3)应用层:AI时代的应用基于底层大模型构建。根据大模型的不同,应用层可分为基于第三方模型构建的应用和基于自建大模型构建的垂直应用两大类。

1.1大语言模型:开、闭源共存以满足不同应用开发需求

双线竞争下,闭源模型和开源模型齐头并进。与软件开发和分发类似,基于代码开发的AI大模型也面临着闭源或开源模型源代码和训练数据的选择。2022年5月,Meta宣布开源拥有1750亿参数的大语言模型OPT,大模型由此开启了闭源和开源的双线竞争。随着模型能力的不断迭代与突破,目前闭源大模型以OpenAI的GPT-4、谷歌的Gemini 1.5 pro、以及Anthropic的Claude 3为代表;开源大模型以谷歌的Gemma、Meta的LLaMA 3、以及Mistral的Mistral 8x7B为代表。

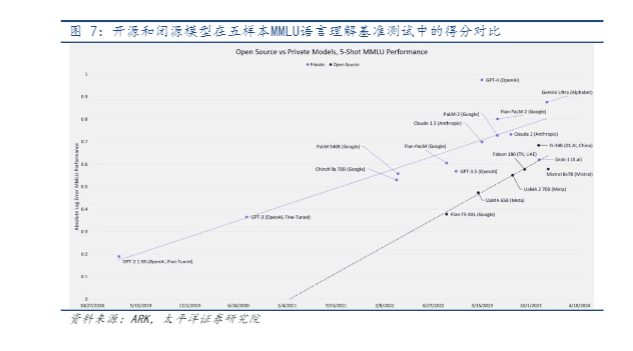

闭源模型:能力优于开源,是模型基础能力上限持续突破的主阵地。2023年3月,OpenAI发布最新大模型GPT-4,其不仅具备对图文输入生成应答文字等多模态能力,还在上下文窗口容量、推理能力等方面实现突破,GPT-4由此成为了最强大模型。随后,谷歌发布Gemini 1.0及更新后的Gemini 1.5 Pro,把上下文窗口容量再次提升。进入2024年,Anthropic发布最新大模型Claude 3,其在模型理解能力(MMLU)、推理能力(GPQA)等再次实现突破,得分超过GPT-4和Gemini 1.0 Ultra,成为目前能力最强的大模型。出于商业竞争、安全等因素的考量,这些模型仍均为闭源模型。对比它们与开源模型在基准测试中的得分,闭源模型表现明显更为突出。头部大模型公司正凭借科研实力、人才、算力资源等优势,成为推动模型基础能力持续实现突破的主要力量。

基于闭源模型的应用通过API实现,同时API能力提升、价格下降。基于闭源模型的应用开发通过连接闭源模型API的形式实现。API接口允许用户将模型功能集成到自己的应用程序或服务中,实现数据的输入输出和模型功能的调用。随着模型不断更新迭代,模型API的能力也正持续进化。以OpenAI为例,其大模型API已完成多次更新,并支持微调功能,逐步为用户提供能力更强、更易用的API服务。其中,最新的GPT-4oAPI实现速度提高2倍,价格便宜50%,调用模型的速率限制较GPT-4-Turbo提高5倍。价格方面,GPTAPI价格呈现随模型能力提升而下降的趋势,最新的GPT-4oAPI输入和输出百万tokens的价格分别为5、15美元,仅为GPT-4 API的16.7%和25%。

开源模型:与闭源模型差距缩小,基于开源模型的应用通过fine-tuning实现。类比于互联网时代开源操作系统Linux和安卓在大量开发人员贡献代码、报告错误等社区共建中实现发展,人工智能时代开源模型也正在社区群策群力、共同开发的支持下,实现模型能力的逐步提升。根据ARK基金统计的开源和闭源模型在五样本MMLU语言理解基准测试中的得分对比,开源模型与闭源模型的测试得分差距正不断缩小。在应用开发层面,以LLaMA为例,通过继续预训练和指令微调的方式,应用开发者能利用自有数据对开源模型进行微调,从而获得与应用更匹配的底层大模型。

趋势一:闭源模型能力或将长期优于开源模型。闭源模型能力或将长期优于开源模型。虽然开源模型与闭源模型的能力差距正在不断缩小,但通过对比开源软件和开源大模型之间的异同,我们认为,大模型能力的提升仍存在如训练数据的规模和质量、算力资源等开源社区无法突破的壁垒。并且,出于商业、伦理道德安全等因素的考虑,闭源模型不会将能力最强的大模型进行开源。因此,闭源模型能力或将长期优于开源模型。

趋势二:开闭源共存以满足不同需求,基于成本和安全等进行选择。连接闭源模型开放API的方式,具备调用便利、无需进行大模型本地化部署和维护的优势;而基于开源模型,并利用数据进行微调的方式,则为专业化、定制化模型或应用的开发提供了支持,两者共存以满足不同的开发需求。我们认为,模型或应用开发者在调用大模型能力时会基于成本及安全等因素,在开闭源模型中进行选择。在成本方面,目前调用闭源模型API的费用根据使用量收取,随着使用量的增加必然会出现调用成本与模型部署和维护成本之间的权衡。当应用调用闭源模型成本大于模型开发和维护成本时,基于开源模型开发拥有更优的成本收益比。在安全方面,对于数据不能轻易泄漏的场景,如公司商业决策等,利用开源模型在私域进行本地化部署是更安全的选择。

1.2多模态模型:技术持续演进,混合多模态有望催生现象级应用

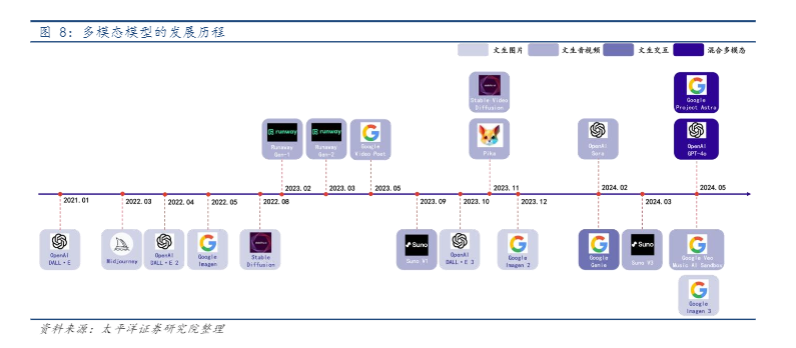

多模态技术持续演进,图像、音视频等领域取得突破性进展。随着对跨模态数据行业深度报告P10融合、人类认知能力模拟等研究的加深,多模态大模型不断发展。2021年初,OpenAI率先发布文生图模型DALL·E,由此拉开多模态模型序幕。此后,文生图领域相继出现谷歌Imagen、Midjourney、Stable Diffusion等模型,不断推升文生图模型能力。在音乐领域,文生音乐模型Suno V3高质量的音乐创作能力让文生音乐开始受到市场关注。在视频领域,Runaway Gen-2、Pika等不断提高生成视频质量,此后OpenAISora不仅将视频长度提升至60秒,还让视频具备了3D一致性。此外,谷歌推出创新性的AI生成式交互环境Genie,实现由单张图像提示生成交互式视频。多模态模型正在头部AI公司与细分赛道领先者的共同推动下持续突破,技术愈发成熟。

混合多模态实时交互变革人机交互方式,有望催生强交互性场景应用。随着图像、音频、视频多模态技术的不断发展,OpenAI发布集成文本、图片、语音、视频的全能混合多模态模型GPT-4o,谷歌发布实时多模态AI助手ProjectAstra。这两个产品均实现了跨模态的实时推理,能将文本、图像、语音、视频的任意组合作为输入,生成文本、图像、语音、视频的任意组合输出,具备实时语音及视频交互的能力,与人和世界交互的方式一致。我们认为,混合多模态的实时交互改变了用户与机器交互的方式,有望在强交互性场景中催生现象级应用。

2.应用层:文本编辑类最成熟,国内有望复制海外路径

2.1应用分类:文本编辑类数量最多、访问量最高

全球访问量前100 AI应用可分为文本编辑、代码编程、图像、音视频/游戏四大类。按照生成内容形式的不同,4月全球访问量前100网页版AI应用可划分为基于大语言模型的文本编辑类和代码编程类应用,以及基于多模态模型的图像类和音视频/游戏类应用。对四大分类涉及的24个细分类目进行统计:文本编辑类应用涉及的领域最广,包括聊天机器人、搜索引擎、虚拟角色、翻译工具等14个细分类目;代码编程类、图像类和音视频/游戏类应用则分别包括2、4、4个细分类目。

四大类应用中文本编辑类技术最成熟,音视频/游戏类技术发展潜力最大。应用层基于模型层进行开发,因此在技术层面模型的成熟程度就决定了应用的成熟程度。具体来看,基于此前自然语言处理等相关技术积累、文本数据获取和处理难度相对较低等因素,AI文本生成技术最早发展起来。从1966年世界上第一个聊天机器人Eliza诞生,到2022年ChatGPT发布,近60年的发展让AI文字生成技术及应用的成熟度最高。同时,随着模型架构、多模态数据处理等技术的不断突破,图像、音视频等跨模态内容的生成技术及应用崭露头角。但因发展时间相对较短,其在技术路径探索上仍存在较大发展潜力。我们认为,大模型作为支撑AI应用发展的底层技术,模型能力决定了应用体量的下限,模型能力与应用场景的适配度决定了应用体量的上限。

四大类应用中文本编辑类数量最多、访问量最高,图像类次之。底层大模型的技术差距造成了应用智能程度、用户体验等的不同,从而使得目前不同分类应用的数量和访问量呈现出明显的不同。在四大类应用中,文本编辑类应用数据表现突出:从应用数量来看,4月访问量排名前100的应用数量最多,占比达58%,访问量过亿的8个应用有7个为文本编辑类;从访问量来看,文本编辑类应用访问量总和达60.4亿,显著高于其他分类。此外,图像类应用成为多模态技术演进中最先发展起来的类目,4月访问量排名前100的应用数量占比达23%,访问量总和达9.16亿,仅次于文本编辑类。

2.2海内外应用对比:整体差距较大,国内有望复制海外发展路径

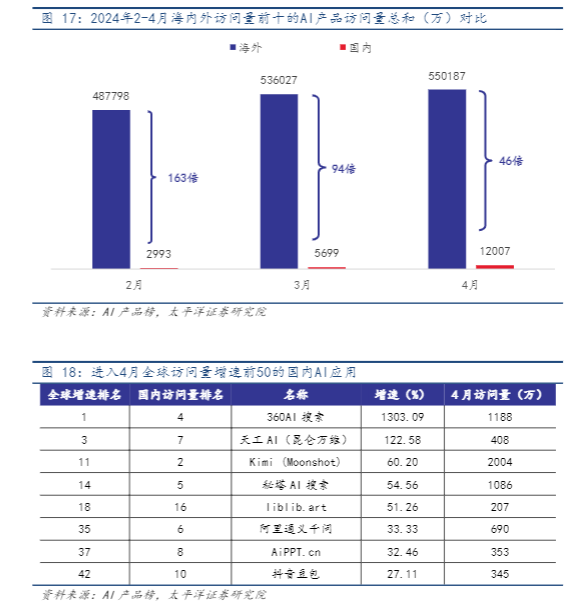

海内外前十应用访问量存在约46倍差距,国内尚未出现超级应用。目前海内外AI应用仍存在较大差距。从进入全球访问量前100的应用数量来看,海外共94个应用入榜,而国内仅有Kimi、百度文心一言等6款应用入榜;从访问量来看,海外前十AI产品的访问量共计55.02亿,而国内仅1.20亿,两者存在约46倍的差距。此外,海外访问量第一的应用ChatGPT访问量达18.6亿,而国内访问量第一的应用Kimi访问量仅2004万,两者存在约93倍的差距(在国内AI产品榜中排名第一的为百度文库AI功能,但因其为在百度文库网页上新的AI功能,访问量或包含未使用AI功能的访问,因此本文选取Kimi的访问量进行对比)。

国内应用持续缩小与海外应用的差距,头部应用高速增长。对比2024年2-4月海内外排名前十的AI产品访问量总和,两者差距从2月的163倍逐渐缩小至4月的46倍。并且,根据4月访问量增速全球前50网页版AI产品榜单,有8个国内应用入榜,且其中7个应用为国内访问量前十应用,表明国内头部应用正高速增长。我们认为,国内AI应用正随底层大模型持续追赶海外主流大模型不断发展,多个头部应用增速表现亮眼,静待超级应用出现。